مشین لرننگ الگورتھم کا دورہ

0

0

3208

3208

مشین لرننگ الگورتھم کا دورہ

مشین لرننگ کے مسائل کو سمجھنے کے بعد ، ہم اس بارے میں سوچ سکتے ہیں کہ ہمیں کون سا ڈیٹا اکٹھا کرنے کی ضرورت ہے اور ہم کون سے الگورتھم استعمال کرسکتے ہیں۔ اس مضمون میں ، ہم مشین لرننگ کے سب سے مشہور الگورتھم پر ایک نظر ڈالیں گے تاکہ یہ معلوم ہوسکے کہ کون سے طریقے استعمال ہوسکتے ہیں۔ مشین لرننگ کے شعبے میں بہت سارے الگورتھم ہیں ، اور ہر الگورتھم میں بہت ساری توسیعیں ہیں ، لہذا کسی خاص مسئلے کے لئے صحیح الگورتھم کی نشاندہی کرنا بہت مشکل ہے۔ اس مضمون میں میں آپ کو دو طریقوں کے بارے میں بتانا چاہتا ہوں جو آپ کو حقیقت میں ملیں گے۔

- #### سیکھنے کا طریقہ

الگورتھم کو مختلف اقسام میں تقسیم کیا جاتا ہے ، اس پر منحصر ہے کہ وہ تجربات ، ماحول یا کسی بھی چیز کو جو ہم ان پٹ کہتے ہیں اس سے کیسے نمٹتے ہیں۔ مشین لرننگ اور مصنوعی ذہانت کی نصابی کتابیں عام طور پر اس بات پر غور کرتی ہیں کہ الگورتھم کس طرح سیکھ سکتے ہیں۔

یہاں صرف چند اہم سیکھنے کے طرز یا سیکھنے کے ماڈل پر بات کی گئی ہے اور چند بنیادی مثالیں ہیں۔ یہ درجہ بندی یا تنظیم کا طریقہ اچھا ہے کیونکہ یہ آپ کو ان پٹ ڈیٹا کے کردار اور ماڈل کی تیاری کے عمل کے بارے میں سوچنے پر مجبور کرتا ہے ، اور پھر آپ کو بہترین نتائج حاصل کرنے کے ل your آپ کے مسئلے کے لئے بہترین فٹ ہونے والا الگورتھم منتخب کریں۔

زیر نگرانی سیکھنا: ان پٹ ڈیٹا کو ٹریننگ ڈیٹا کہا جاتا ہے اور اس کے نتائج معلوم ہوتے ہیں یا اس کو نشان زد کیا جاتا ہے۔ مثال کے طور پر یہ کہنا کہ آیا ایک ای میل اسپام ہے یا نہیں ، یا ایک مدت کے دوران اسٹاک کی قیمت۔ ماڈل پیش گوئی کرتا ہے ، اگر غلط ہے تو اسے درست کیا جائے گا ، اور یہ عمل اس وقت تک جاری رہتا ہے جب تک کہ یہ ٹریننگ ڈیٹا کے لئے کسی خاص درست معیار پر پورا نہیں اترتا ہے۔ مثال کے طور پر مسئلے میں درجہ بندی اور واپسی کے مسائل شامل ہیں ، اور الگورتھم کی مثالوں میں منطقی واپسی اور الٹ نیورل نیٹ ورک شامل ہیں۔ غیر نگرانی سیکھنے: ان پٹ ڈیٹا کو نہ تو نشان زد کیا جاتا ہے اور نہ ہی اس کا کوئی نتیجہ طے کیا جاتا ہے۔ ماڈل اعداد و شمار کی ساخت اور عددی اقدار کا انضمام کرتا ہے۔ مثال کے طور پر ایسوسی ایشن رول لرننگ اور کلسٹرنگ کے مسائل شامل ہیں۔ الگورتھم کی مثالوں میں اپریوری الگورتھم اور K- اوسط الگورتھم شامل ہیں۔ نیم نگرانی سیکھنے: ان پٹ ڈیٹا کو نشان زد اور غیر نشان زد اعداد و شمار کا ایک مرکب کہا جاتا ہے ، جس میں کچھ پیش گوئی کے مسائل ہیں لیکن ماڈل کو اعداد و شمار کی ساخت اور تشکیل کو بھی سیکھنا ہوگا۔ مسئلہ کی مثالوں میں درجہ بندی اور رجعت کے مسائل شامل ہیں ، الگورتھم کی مثالیں بنیادی طور پر غیر نگرانی سیکھنے کے الگورتھم کی توسیع ہیں۔ تقویت یافتہ سیکھنا: ان پٹ ڈیٹا ماڈل کو متحرک کرتا ہے اور ماڈل کو ردعمل کا اظہار کرنے پر مجبور کرتا ہے۔ رائے نہ صرف نگرانی سیکھنے کے سیکھنے کے عمل سے حاصل کی جاتی ہے بلکہ ماحول میں انعامات یا سزا سے بھی حاصل کی جاتی ہے۔ مثال کے طور پر مسئلہ روبوٹ کنٹرول ہے ، الگورتھم کی مثالوں میں Q-learning اور Temporal difference learning شامل ہیں۔

جب اعداد و شمار کے تخروپن کے کاروباری فیصلوں کو مربوط کیا جاتا ہے تو ، زیادہ تر لوگوں نے نگرانی سیکھنے اور غیر نگرانی سیکھنے کے طریقوں کا استعمال کیا ہے۔ اگلا گرم موضوع نیم نگرانی سیکھنے ہے ، جیسے امیج کی درجہ بندی کا مسئلہ ، جس میں ایک بہت بڑا ڈیٹا بیس ہے ، لیکن اس میں صرف ایک چھوٹی سی تعداد میں تصاویر کو نشان زد کیا گیا ہے۔ زیادہ تر سیکھنے کا استعمال روبوٹ کنٹرول اور دیگر کنٹرول سسٹم کی ترقی میں کیا جاتا ہے۔

- #### الگورتھم کی مماثلت

الگورتھم بنیادی طور پر فنکشن یا شکل کے لحاظ سے درجہ بندی کیے جاتے ہیں۔ مثال کے طور پر ، درخت پر مبنی الگورتھم ، نیورل نیٹ ورک الگورتھم۔ یہ ایک مفید درجہ بندی کا طریقہ ہے ، لیکن یہ کامل نہیں ہے۔ کیونکہ بہت سے الگورتھم آسانی سے دو اقسام میں تقسیم ہوسکتے ہیں ، مثال کے طور پر ، سیکھنے ویکٹر کوانٹائزیشن نیورل نیٹ ورک کلاس کے الگورتھم اور مثال پر مبنی طریقہ ہے۔ جس طرح مشین لرننگ الگورتھم کے پاس خود کامل ماڈل نہیں ہے ، اسی طرح الگورتھم کی درجہ بندی کا طریقہ بھی کامل نہیں ہے۔

اس حصے میں میں نے ان الگورتھموں کی فہرست دی ہے جو میں سمجھتا ہوں کہ درجہ بندی کرنے کا سب سے زیادہ بدیہی طریقہ ہے۔ میں الگورتھموں یا درجہ بندی کے طریقوں کو ختم نہیں کر رہا ہوں ، لیکن میں سمجھتا ہوں کہ یہ قارئین کو ایک عام سمجھنے میں مددگار ثابت ہوگا۔ اگر آپ کو معلوم ہے کہ میں نے ان میں سے کسی کو درج نہیں کیا ہے تو ، تبصرہ کرنے میں خوش آمدید۔ اب ہم شروع کرتے ہیں!

- #### Regression

رجریشن متغیرات کے مابین تعلقات سے متعلق ہے۔ اس کا اطلاق شماریاتی طریقوں پر ہوتا ہے۔ اس کے کچھ مثالوں میں شامل ہیں:

Ordinary Least Squares Logistic Regression Stepwise Regression Multivariate Adaptive Regression Splines (MARS) Locally Estimated Scatterplot Smoothing (LOESS)

- #### Instance-based Methods

مثال پر مبنی سیکھنے میں ایک فیصلہ سازی کا مسئلہ ماڈل کیا جاتا ہے ، جس میں استعمال ہونے والے مثال یا مثال ماڈل کے لئے بہت اہم ہوتی ہے۔ یہ طریقہ موجودہ اعداد و شمار کا ایک ڈیٹا بیس بناتا ہے اور پھر اس میں نیا ڈیٹا شامل کرتا ہے ، پھر ایک مماثلت کی پیمائش کے طریقہ کار کا استعمال کرتا ہے تاکہ ڈیٹا بیس میں ایک بہترین میچ تلاش کیا جاسکے ، جس سے ایک پیش گوئی کی جاسکے۔ اس وجہ سے ، اس طریقہ کار کو فاتح کے لئے بادشاہ کا طریقہ اور میموری پر مبنی طریقہ بھی کہا جاتا ہے۔ اب توجہ کا مرکز ڈیٹا اسٹوریج کی کارکردگی اور مماثلت کی پیمائش کے طریقوں پر ہے۔

k-Nearest Neighbour (kNN) Learning Vector Quantization (LVQ) Self-Organizing Map (SOM)

- #### Regularization Methods

یہ دیگر طریقوں کی توسیع ہے (عام طور پر رجعت کا طریقہ) ، یہ توسیع زیادہ آسان ماڈل کے لئے زیادہ فائدہ مند ہے، اور زیادہ بہتر انضمام میں ہے۔ میں اسے یہاں درج کرتا ہوں کیونکہ یہ مقبول اور طاقتور ہے۔

Ridge Regression Least Absolute Shrinkage and Selection Operator (LASSO) Elastic Net

- #### Decision Tree Learning

Decision tree methods ایک ایسا ماڈل بناتا ہے جس میں اعداد و شمار میں موجود حقیقی اقدار کی بنیاد پر فیصلے کیے جاتے ہیں۔ فیصلہ درخت انضمام اور رجعت کے مسائل کو حل کرنے کے لیے استعمال ہوتے ہیں۔

Classification and Regression Tree (CART) Iterative Dichotomiser 3 (ID3) C4.5 Chi-squared Automatic Interaction Detection (CHAID) Decision Stump Random Forest Multivariate Adaptive Regression Splines (MARS) Gradient Boosting Machines (GBM)

- #### Bayesian

Bayesian method (Bayesian method) درجہ بندی اور رجعت کے مسائل کو حل کرنے میں Bayesian تھیوری کا اطلاق کرنے کا طریقہ ہے۔

Naive Bayes Averaged One-Dependence Estimators (AODE) Bayesian Belief Network (BBN)

- #### Kernel Methods

Kernel Method میں سے سب سے مشہور Support Vector Machines ہیں۔ یہ طریقہ کار ان پٹ ڈیٹا کو اعلی جہت پر نقشہ کرتا ہے ، جس سے درجہ بندی اور رجعت کے مسائل کو ماڈل کرنا آسان ہوجاتا ہے۔

Support Vector Machines (SVM) Radial Basis Function (RBF) Linear Discriminate Analysis (LDA)

- #### Clustering Methods

کلسٹرنگ (انگریزی: Clustering) ، خود ہی مسئلہ اور طریقہ کار کی وضاحت کرتی ہے۔ کلسٹرنگ کے طریقوں کو عام طور پر ماڈلنگ کے طریقوں سے درجہ بندی کیا جاتا ہے۔ تمام کلسٹرنگ کے طریقوں کو اعداد و شمار کو ایک ہی ڈیٹا ڈھانچے کے ساتھ منظم کیا جاتا ہے تاکہ ہر گروپ میں زیادہ سے زیادہ مشترکات ہوں۔

K-Means Expectation Maximisation (EM)

- #### Association Rule Learning

ایسوسی ایشن رول لرننگ (انگریزی: Association rule learning) اعداد و شمار کے مابین قواعد اخذ کرنے کا ایک طریقہ ہے جس کے ذریعہ کثیر جہتی اعداد و شمار کے مابین روابط کو دریافت کیا جاسکتا ہے ، اور یہ اہم روابط تنظیم کے ذریعہ استعمال ہوسکتے ہیں۔

Apriori algorithm Eclat algorithm

- #### Artificial Neural Networks

مصنوعی اعصابی نیٹ ورک حیاتیاتی اعصابی نیٹ ورک کی ساخت اور افعال سے متاثر ہیں۔ یہ نمونہ مماثلت کی ایک قسم ہے ، جو اکثر رجعت اور درجہ بندی کے مسائل کے لئے استعمال ہوتا ہے ، لیکن اس میں سیکڑوں الگورتھم اور مختلف قسمیں ہیں۔ ان میں سے کچھ کلاسک مقبول الگورتھم ہیں (میں گہری سیکھنے کو الگ الگ کرتا ہوں):

Perceptron Back-Propagation Hopfield Network Self-Organizing Map (SOM) Learning Vector Quantization (LVQ)

- #### Deep Learning

ڈیپ لرننگ (Deep Learning) طریقہ کار مصنوعی اعصابی نیٹ ورک کی ایک جدید تازہ کاری ہے۔ روایتی اعصابی نیٹ ورک کے مقابلے میں اس میں زیادہ سے زیادہ پیچیدہ نیٹ ورک کی تشکیل ہوتی ہے۔ بہت سے طریقے نیم نگرانی سیکھنے سے متعلق ہیں ، اس طرح کے سیکھنے کے مسئلے میں بہت بڑا ڈیٹا ہے ، لیکن اس میں سے بہت کم ڈیٹا کو نشان زد کیا گیا ہے۔

Restricted Boltzmann Machine (RBM) Deep Belief Networks (DBN) Convolutional Network Stacked Auto-encoders

- #### Dimensionality Reduction

Dimensionality Reduction (طول و عرض میں کمی) ، جیسا کہ کلسٹرنگ کا طریقہ ہے ، اعداد و شمار میں یکساں ڈھانچے کا حصول اور استحصال کرتا ہے ، لیکن یہ اعداد و شمار کو کم معلومات کے ساتھ انضمام اور بیان کرنے کے لئے استعمال کرتا ہے۔ یہ اعداد و شمار کو دیکھنے یا اعداد و شمار کو آسان بنانے کے لئے مفید ہے۔

Principal Component Analysis (PCA) Partial Least Squares Regression (PLS) Sammon Mapping Multidimensional Scaling (MDS) Projection Pursuit

- #### Ensemble Methods

Ensemble methods کئی چھوٹے ماڈلز پر مشتمل ہوتے ہیں، جو الگ الگ تربیت یافتہ ہوتے ہیں، الگ الگ نتائج اخذ کرتے ہیں اور آخر میں ایک مجموعی پیش گوئی بناتے ہیں۔ بہت ساری تحقیق اس بات پر مرکوز ہے کہ کون سے ماڈل استعمال کیے جاتے ہیں اور ان ماڈلز کو کیسے اکٹھا کیا جاتا ہے۔ یہ ایک بہت ہی طاقتور اور مقبول تکنیک ہے۔

Boosting Bootstrapped Aggregation (Bagging) AdaBoost Stacked Generalization (blending) Gradient Boosting Machines (GBM) Random Forest

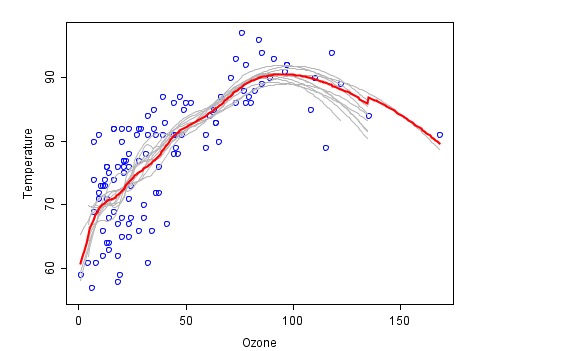

یہ ایک مثال ہے کہ ہم آہنگی کا استعمال کرتے ہوئے ہم آہنگی کا استعمال کیا جاتا ہے ((ویکیپیڈیا سے) ، ہر فائر فائر کوڈ کو گرے میں ظاہر کیا جاتا ہے، اور حتمی پیش گوئی کی حتمی پیش گوئی سرخ ہوتی ہے.

- #### دیگر وسائل

اس مشین لرننگ الگورتھم ٹور کا مقصد آپ کو کچھ الگورتھم اور اس سے متعلقہ الگورتھم کے بارے میں کچھ ٹولز کی مجموعی معلومات فراہم کرنا ہے۔

ذیل میں کچھ دیگر وسائل ہیں ، براہ کرم زیادہ نہ سمجھو ، زیادہ سے زیادہ الگورتھم جاننے سے آپ کو فائدہ ہوگا ، لیکن کچھ الگورتھم کے بارے میں گہری معلومات بھی مفید ثابت ہوسکتی ہیں۔

- List of Machine Learning Algorithms: یہ وکیپیڈیا پر موجود ایک وسائل ہے، جو کافی جامع ہے، لیکن مجھے لگتا ہے کہ اس کی درجہ بندی بہت اچھی نہیں ہے۔

- Machine Learning Algorithms Category: یہ وکیپیڈیا پر بھی موجود ہے، جو اوپر سے تھوڑا بہتر ہے، حروف تہجی کے مطابق ترتیب دیا گیا ہے۔

- CRAN Task View: Machine Learning & Statistical Learning: مشین لرننگ الگورتھم کے لیے R زبان کا ایک توسیع پیکیج، یہ دیکھنے کے لیے کہ کیا آپ جانتے ہیں کہ دوسرے لوگ کیا استعمال کر رہے ہیں۔

- ڈیٹا کان کنی میں ٹاپ 10 الگورتھم: یہ ایک شائع شدہ مضمون ہے ، اب یہ ایک کتاب ہے ، جس میں سب سے زیادہ مقبول ڈیٹا کان کنی الگورتھم شامل ہیں۔ ایک اور بنیادی الگورتھم کی فہرست ، یہاں درج الگورتھم بہت کم ہیں ، جو آپ کو گہرائی میں سیکھنے میں مدد فراہم کریں گے۔

ٹویٹ ایمبیڈ کریں