Aplikasi Python Naive Bayes

0

0

2278

2278

Aplikasi Python Naive Bayes

Dengan asumsi bahawa antara pembolehubah adalah bebas antara satu sama lain, kaedah klasifikasi Bayes yang sederhana dapat diperoleh berdasarkan teorema Bayes. Secara lebih sederhana, klasifikasi Bayes yang sederhana mengandaikan bahawa ciri-ciri klasifikasi tidak berkaitan dengan ciri-ciri lain dalam klasifikasi. Sebagai contoh, jika buah itu bulat dan merah, dan berdiameter kira-kira 3 inci, maka buah itu mungkin epal. Walaupun ciri-ciri ini saling bergantung, atau bergantung pada ciri-ciri lain, klasifikasi Bayes yang sederhana akan mengandaikan bahawa ciri-ciri ini secara bebas menunjukkan bahawa buah itu adalah epal.

- #### Model Bayesian sederhana mudah dibina, dan sangat berguna untuk set data besar. Walaupun sederhana, Bayesian sederhana bertindak melampaui kaedah pengelompokan yang sangat rumit.

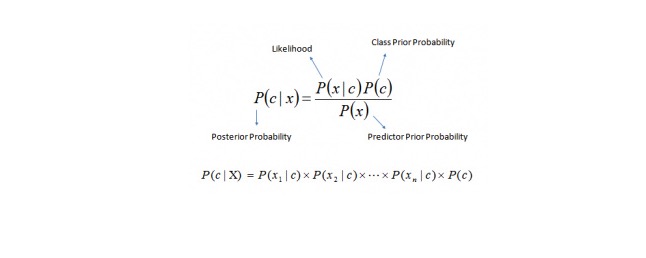

Teorema Bayes menyediakan satu kaedah untuk mengira kebarangkalian ujian akhir P © dari P © dan P (x) dan P (x) dan P ©. Lihat persamaan berikut:

Di sini,

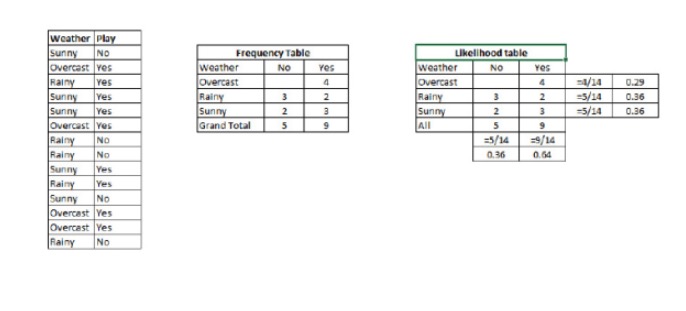

P © adalah kebarangkalian kewujudan kelas (tujuan) dengan asumsi bahawa variabel ramalan (sifat) diketahui. P © adalah kebarangkalian terdahulu bagi kelas P (x) adalah kebarangkalian, iaitu kemungkinan untuk meramalkan suatu variabel dengan asumsi kelas yang diketahui. P (x) adalah kebarangkalian awal bagi pemboleh ubah ramalan Contoh: Mari kita fahami konsep ini dengan contoh. Di bawah ini, saya mempunyai set latihan cuaca dan pemacu sasaran yang sesuai. Sekarang, kita perlu membezakan peserta yang bermain dan yang tidak bermain berdasarkan keadaan cuaca. Mari kita lakukan langkah-langkah berikut.

Langkah 1: Ubah set data menjadi jadual frekuensi.

Langkah 2: Buat Jadual Kebarangkalian dengan menggunakan Jadual Kebarangkalian yang sama apabila kemungkinan Overcast adalah 0.29 dan kemungkinan bermain adalah 0.64 Jadual.

Langkah 3: Sekarang, gunakan persamaan Bayes sederhana untuk mengira kebarangkalian terbalik bagi setiap kelas. Kelas yang mempunyai kebarangkalian terbalik terbesar adalah hasil yang diramalkan.

Soalan: Adakah kenyataan ini benar bahawa peserta boleh bermain jika cuaca cerah?

Kita boleh menggunakan kaedah yang telah kita bincangkan untuk menyelesaikan masalah ini. Jadi P (bermain) = P (bermain) * P (bermain) / P (bermain).

Jadi kita ada P = 3⁄9 = 0.33, P = 5⁄14 = 0.36, P = 9⁄14 = 0.64.

Sekarang, P (bermain) = 0.33 * 0.64 / 0.36 = 0.60, lebih besar kemungkinan.

Bayes yang polos menggunakan kaedah yang serupa untuk meramalkan kebarangkalian kategori yang berbeza melalui sifat yang berbeza. Algoritma ini biasanya digunakan untuk mengklasifikasikan teks, dan juga untuk masalah yang melibatkan beberapa kategori.

- #### Kod Python:

#Import Library

from sklearn.naive_bayes import GaussianNB

#Assumed you have, X (predictor) and Y (target) for training data set and x_test(predictor) of test_dataset

Create SVM classification object model = GaussianNB()

there is other distribution for multinomial classes like Bernoulli Naive Bayes, Refer link

Train the model using the training sets and check score

model.fit(X, y) #Predict Output predicted= model.predict(x_test)